OpenAI 研究和安全 VP Lilian Weng 宣布离职

OpenAI 又失去了一位高管,研究和安全 VP Lilian Weng 今天宣布,在 OpenAI 工作 7 年后离职,她之前曾担任 OpenAI 安全系统团队的负责人。

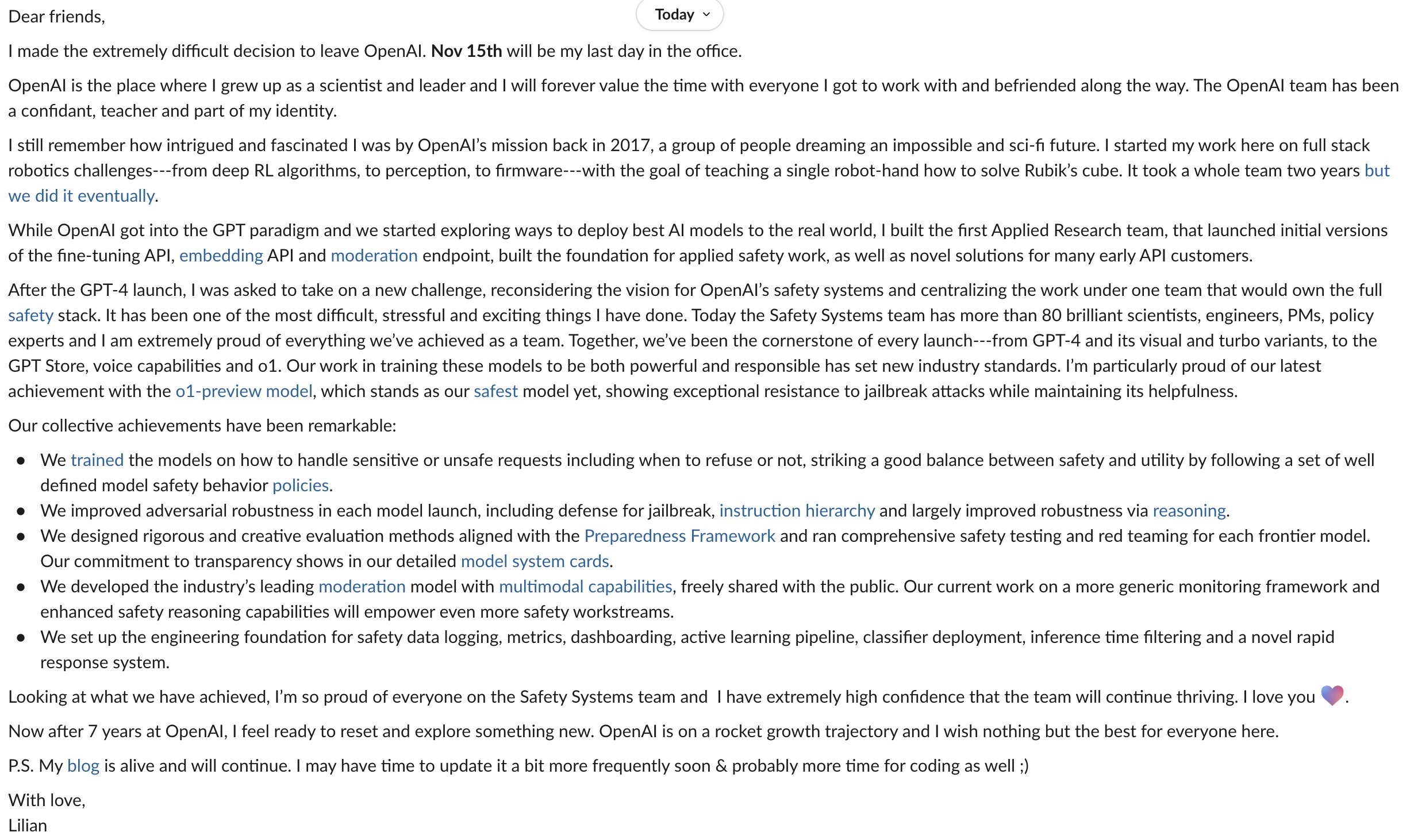

Lilian Weng 在 X 发了一个图片帖子这样说:

亲爱的朋友们,

我做出了一个非常艰难的决定:离开 OpenAI。11 月 15 日将是我在办公室的最后一天。

OpenAI 是我作为科学家和领导者成长的地方,我将永远珍视与每一位共事并建立友谊的时光。OpenAI 团队不仅是我的伙伴、老师,更是我身份的一部分。

我还记得 2017 年刚加入 OpenAI 时的那份好奇和着迷——一群人怀揣着实现不可能和科幻未来的梦想。我最初的工作是全栈机器人挑战——从深度强化学习算法到感知,再到固件——目标是教一个机器人如何一步步地解决魔方。这个项目用了整整两年的时间,但我们最终做到了。

随着 OpenAI 开始专注于 GPT 范式,我们探索如何将最好的 AI 模型部署到现实世界。我组建了第一个应用研究团队,推出了包括微调 API、嵌入 API 和内容审核端点在内的初始版本,为应用安全工作的基础打下了坚实的基础,同时还为众多早期 API 客户提供了许多新颖的解决方案。

在 GPT-4 推出后,我被委派承担一个新挑战,重新考虑 OpenAI 的安全系统愿景,并将整个安全体系整合到一个团队中,以管理完整的安全技术栈。这是我做过的最艰难但也最激动人心的工作之一。如今,安全系统团队拥有超过 80 位才华横溢的科学家、工程师、产品经理、政策专家,我对我们作为团队取得的成果无比自豪。我们一起成为了每一次发布的基石——从 GPT-4 及其视觉和 Turbo 变体,到 GPT 商店、语音功能和 o1 模型。我们训练这些模型的工作既强大又负责任,设立了新的行业标准。我特别自豪的是我们最近推出的 o1 预览模型,这是我们迄今为止最安全的模型,在保持实用性的同时表现出对绕过限制的极强抵抗力。

我们的集体成就非常值得称道:

• 我们训练模型如何处理敏感或不安全请求,包括何时拒绝或不回应,遵循一套明确的安全行为准则,以在安全性和实用性之间取得良好平衡。

• 我们在每次模型发布中提升了对抗性稳健性,包括对绕过限制的防御、指令层次结构,以及通过推理大幅度提升稳健性。

• 我们设计了符合预备框架的严格而有创意的评估方法,针对每个前沿模型进行全面的安全测试和压力测试。

• 我们对透明度的承诺体现在详细的模型系统卡片中,已公开与大众分享。

• 我们开发了业内领先的多模式内容审核模型,免费与公众分享。我们当前关于更通用的监控框架和增强安全推理能力的工作将进一步加强更多的安全工作流程。

• 我们为安全数据日志记录、指标、仪表盘、主动学习流程、分类器部署、推理时间筛选和新型快速响应系统建立了工程基础。

回顾我们所取得的成就,我为安全系统团队中的每个人感到自豪,并且我对团队的持续发展充满信心。我爱你们 💜。

现在,在 OpenAI 工作了 7 年之后,我准备好重整旗鼓,探索一些新的事物。OpenAI 正在飞速发展,我祝愿每一个人都能一帆风顺。

附言:我的博客会保持在线并更新。我可能会有更多时间更新博客 & 也许会有更多时间编码 ;)

满怀爱意的,

Lilian