Manus 8 个月突破 1 亿美金 ARR,让我眼前一亮的语音 AI 产品种子轮拿了 4000 多万美金

在 8 月份宣布突破 9000 万美金年化收入后《Manus 年化收入突破 9000 万美金,红杉中国投了一个 AI 床垫》,Manus 昨晚宣布其 ARR 已经突破了 1 亿美金,成为从 0 到 1 亿美金 ARR 最快的初创公司。

Manus 的总收入年化运行率则超过了 1.25 亿美金,这块数据包含了基于使用量的收入和其他业务收入。自 Manus 1.5 发布以来,其月度复合增长率超过 20%。

根据之前的介绍,1.5 版本一个改进是任务完成速度快了近 4 倍,另一个就是可以构建完整的 Web 应用。与典型的“AI 网站构建器”不同,它可以在单一上下文中执行整个价值链:研究并产出深度内容,构建网站,分析用户交互数据,并基于这些发现生成见解或演示幻灯片。

前几天更新的版本则可以直接通过 Manus 来做移动开发了,这块我之前介绍过专注于开发 App 的 AI Coding 产品,《创立 6 个月的 AI 卖了 8000 万美金没融资一个创始人,App 的 AI Coding 也火了》。

有网友说通过 Manus 开发了一个完整的移动 App,我简单体验了一下让它构建一个 AI 笔记产品,效果还不错,包括后端、数据库这些全都自己设计好了,我只需要集成一个 OpenAI 的 API 即可,并且给出了发布到 App Store 的指南。

Manus 没有公布用户的分布情况,不过我在 X 上简单做了一下搜索,发现有不少日本用户分享了通过 Manus 做各种产品的帖子,特别是用它来做移动 App 和 Web 产品这块,我估计来自日本的用户有不少比例。

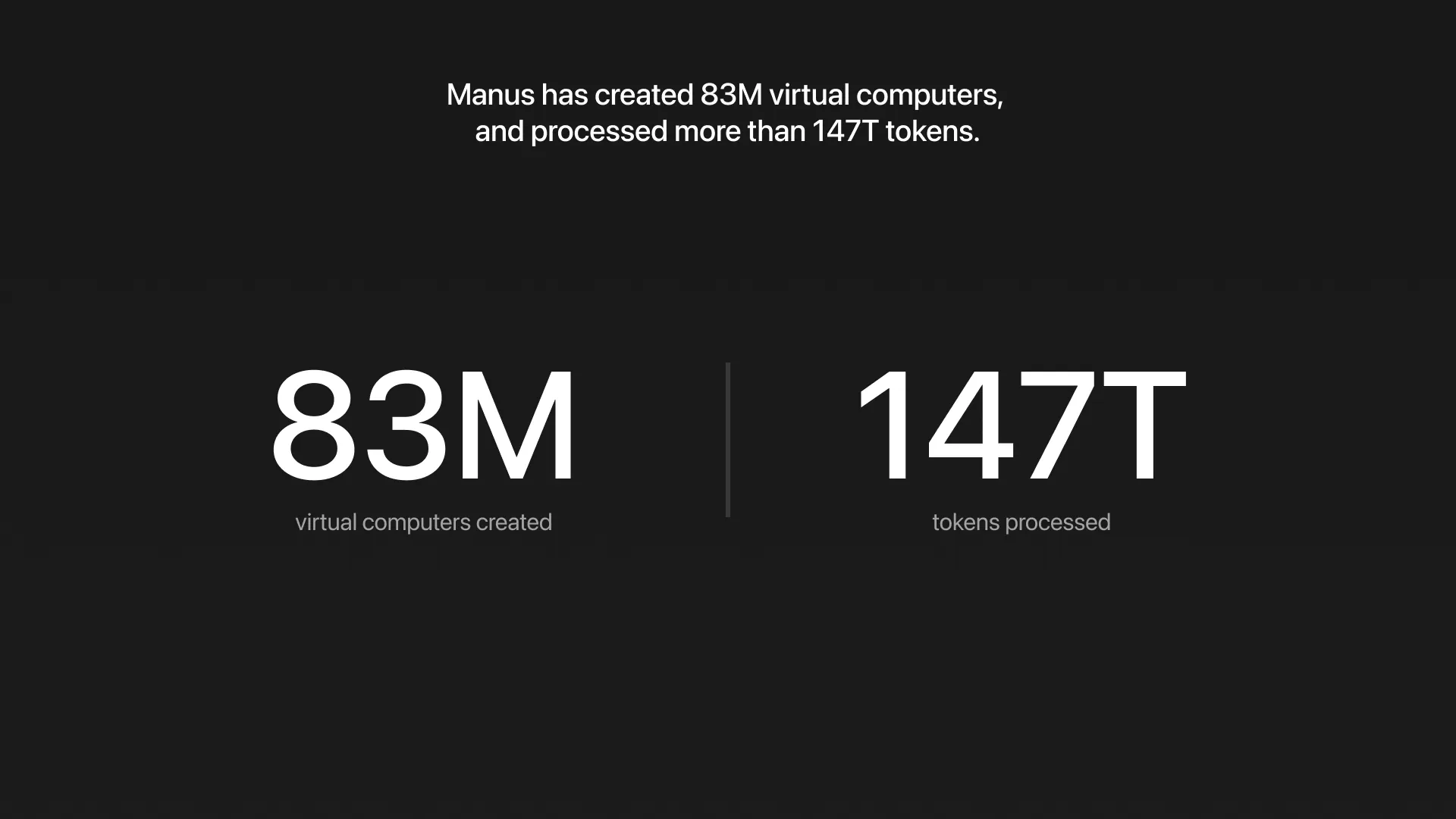

Manus 说,自上线首个通用 Agent 以来,已经累计处理了超过 147 万亿的 Tokens,创建了超过 8000 万个虚拟计算机实例。

之前 Manus 根据其自身实践分享了几个构建通用 AI Agent 在上下文工程(Context Engineering)的经验,我觉得很有价值,其结论是与其通过微调模型来提升能力,不如通过优化上下文管理来让代理更聪明、更高效。

首先就是优先考虑 KV 缓存(KV-Cache),这需要保持前缀稳定,避免在系统提示词开头放置动态信息(如时间戳),同时通过只增不删来确保上下文序列化是确定性的,避免修改过往的操作记录。

第二个是遮蔽(Masking)而非移除工具,当工具数量爆炸时,动态删除工具会导致模型困惑和缓存失效。

第三个经验是将文件系统作为外部记忆,长上下文不仅昂贵,还会导致模型性能下降。因此需要持久化存储,让模型学会读写文件,将文件系统视为无限大的“结构化外部记忆”。其次要可恢复压缩,移除不必要的原始数据(如 HTML),但保留路径或 URL,以便需要时重新找回。

第四个经验是通过“复述”引导注意力,Manus 会在上下文中不断更新 todo.md。这通过自然语言将全局目标反复推送到模型的近期注意力范围内,防止代理在长任务中偏离目标。

最后是保留错误的记录,因为错误即经验,不要清理失败的尝试。将错误的行动、观察结果和堆栈跟踪保留在上下文中,能让模型意识到之前的路径行不通,从而实现“错误恢复”和自我修正。

其核心观点是,代理的未来在于如何巧妙地塑造上下文。如果你能设计好记忆、环境和反馈循环,即便底层模型不变,代理的表现也会有质的飞跃。

与此同时,最近终于又出来了一个让我眼前一亮并且很看好的 AI 产品(模型),种子轮就拿了 4000 多万美金,它跟 ElevenLabs 类似属于语音 AI 这个方向,虽然看起来聚焦的领域更加细分,但却是一个非常庞大且被几乎所有人都忽略了的市场。

我把它称为 AI 视频语音,这是一个随着 AI 视频普及而指数级增长的需求,当所有 AI 都聚焦于